Últimamente, se ha hablado más de agentes de IA que toman una orden y llevan a cabo físicamente la tarea, incluidos los toques y deslizamientos necesarios, en su teléfono. Esta discusión sobre la creación de un agente de IA me recuerda mucho al “nuevo Asistente de Google” anunciado con el Pixel 4 en 2019.

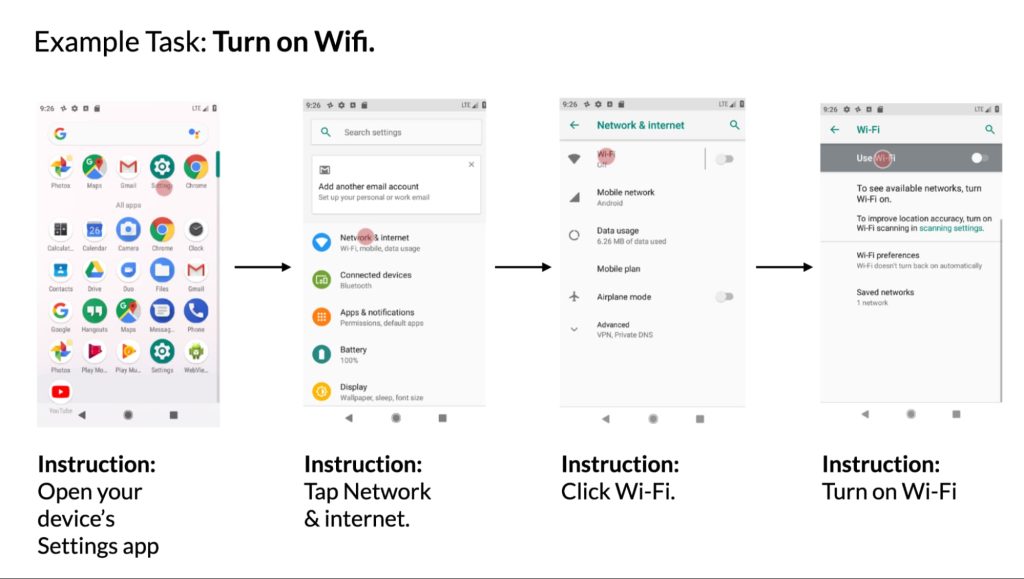

En el I/O 2019, Google presentó por primera vez este asistente de próxima generación. La premisa era que el procesamiento de voz en el dispositivo haría que «presionar para operar el teléfono» pareciera casi lento.

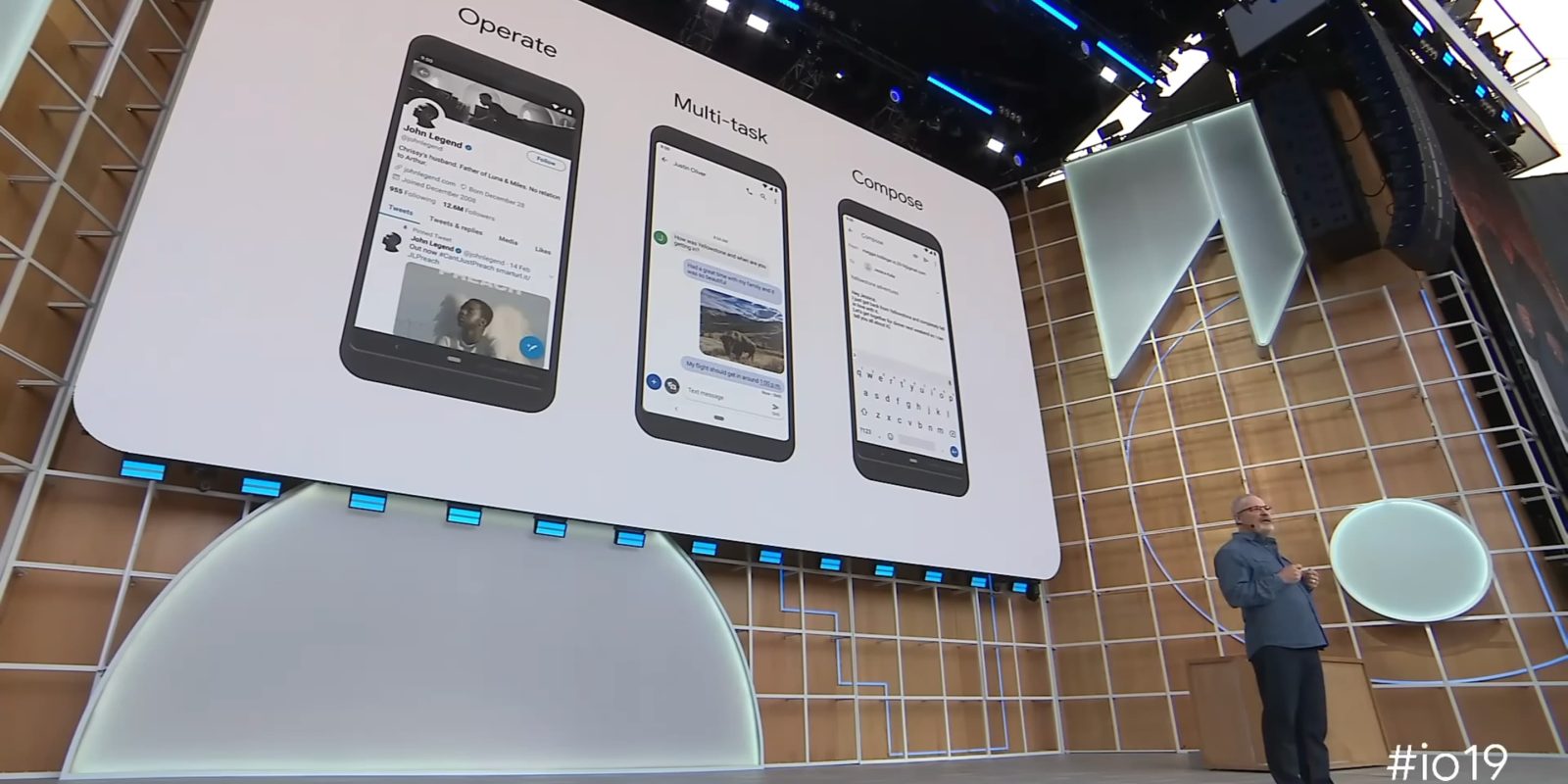

Google presentó comandos simples que implican abrir y controlar aplicaciones, mientras que la idea más compleja era «cómo el Asistente en el dispositivo podría orquestar tareas entre aplicaciones». El ejemplo implicó recibir un mensaje de texto entrante, responder por voz y luego tener la idea de buscar y enviar una foto adjunta. La capacidad de «trabajar» y «realizar múltiples tareas» se ha complementado con una función de «escritura» en lenguaje natural en Gmail.

Este asistente de próxima generación le permitirá usar instantáneamente su teléfono con su voz, realizar múltiples tareas en múltiples aplicaciones y realizar acciones complejas, todo con una latencia casi nula.

El nuevo Asistente se lanzó en el Pixel 4 ese mismo año y estuvo disponible en todos los dispositivos de Google posteriores.

- «Toma una selfie.» Luego diga: «Comparte esto con Ryan».

- En un hilo, diga «Responder, ya voy».

- «Busca clases de yoga en YouTube». Luego diga: “Comparte esto con mamá”.

- «Muéstrame los correos electrónicos de Michelle en Gmail».

- Cuando la aplicación Google Photos esté abierta, diga «Muéstrame fotos de Nueva York». Luego diga «Los de Central Park».

- Cuando un sitio de recetas esté abierto en Chrome, diga «Buscar brownies de chocolate y nueces».

- Con una aplicación de viajes abierta, diga «Hoteles en París».

Ésta es la idea fundamental detrás de los agentes de IA. Durante una llamada sobre resultados de Alphabet el mes pasado, se le preguntó a Sundar Pichai sobre el impacto de la IA generativa en Assistant. Dijo que esto permitiría al Asistente de Google «actuar más como un agente con el tiempo» e «ir más allá de responder y rastrear a los usuarios».

De acuerdo a Información Esta semana, OpenAI está trabajando en un agente ChatGPT de este tipo:

«Este tipo de solicitudes incitarían al agente a realizar clics, movimientos del cursor, entrada de texto y otras acciones que los humanos realizan cuando trabajan con diferentes aplicaciones, según una persona con conocimiento del esfuerzo».

Luego está Rabbit con su modelo de acción grande (LAM) entrenado para interactuar con interfaces móviles y de escritorio existentes para realizar una tarea definida.

La versión 2019 del Asistente de Google parecía muy preprogramada, lo que requería que los usuarios se apegaran a ciertas frases en lugar de dejar que las personas hablaran con naturalidad y luego discernieran automáticamente la acción. En ese momento, Google dijo que el Asistente «funciona perfectamente con muchas aplicaciones» y que «continuaría mejorando las integraciones de aplicaciones con el tiempo». Hasta donde sabemos, esto nunca ha sucedido realmente, aunque algunas de las funciones presentadas por Google ya no funcionan debido a que la aplicación cambió. Un agente real sería capaz de adaptarse en lugar de depender de condiciones establecidas.

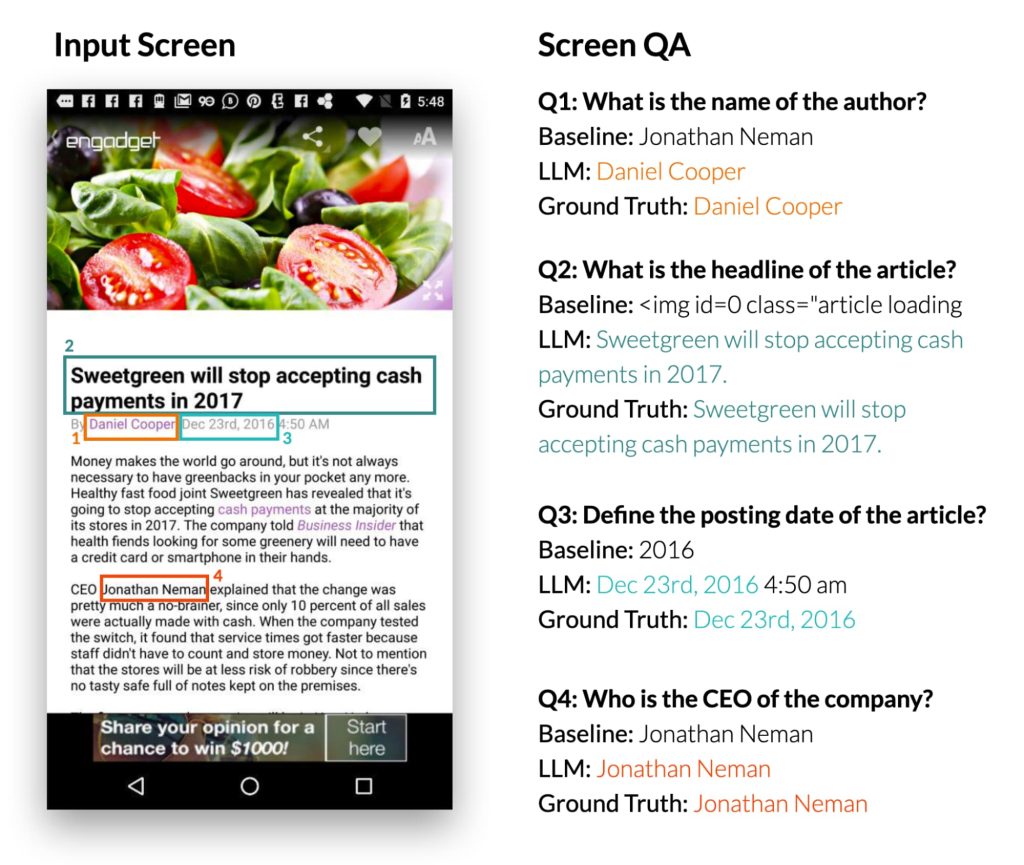

Es fácil ver cómo los LLM podrían mejorar en esto, ya que el año pasado Google Research mostró trabajos en «Habilitar la interacción conversacional con la interfaz de usuario móvil utilizando modelos de lenguaje grandes.”

Google Research demostró que su enfoque fue capaz de “comprender rápidamente el propósito de una interfaz de usuario móvil”:

Curiosamente, observamos que los LLM utilizaron su conocimiento previo para inferir información que no se presenta en la interfaz de usuario al crear resúmenes. En el siguiente ejemplo, el LLM ha deducido que las estaciones de metro pertenecen al sistema de metro de Londres, aunque la interfaz de usuario de entrada no contiene esta información.

También puede responder preguntas sobre el contenido que aparece en la interfaz de usuario y controlarlo después de recibir instrucción en lenguaje natural.

Un agente Gemini AI para su dispositivo Android sería la evolución natural del primer intento de Google, que nunca tuvo éxito como un asistente con todas las funciones que ofrece una nueva forma de usar su teléfono. Sin embargo, funciones como transcribir la respuesta de un mensaje y luego poder decir «enviar» en vivo en la escritura por voz del Asistente de Gboard.

Parece que el esfuerzo anterior se debió a que Google tuvo una idea demasiado pronto y no tenía la tecnología necesaria. Ahora que está aquí, Google haría bien en priorizar este esfuerzo para poder empezar a liderar el grupo en lugar de ponerse al día.

FTC: Utilizamos enlaces de afiliados automáticos que generan ingresos. Más.

«Defensor de los viajes extremos. Amante del café. Experto en tocino total. Wannabe tv pionero».

También te puede interesar

-

XBOX redefine su identidad y adopta oficialmente las mayúsculas en redes sociales

-

Cómo el ultraciclista Kabir Rachure recorrió 900 km en bicicleta a través de Ladakh para establecer un récord

-

Google Meet obtiene una nueva función de IA generativa «Toma notas por mí»

-

Google implementa Gems e Imagen 3 en Gemini Advanced

-

Infinix Hot 50 5G con procesador MediaTek Dimensity y clasificación IP54 lanzado el 5 de septiembre: características esperadas